วันศุกร์ ที่ 5 มิถุนายน พ.ศ. 2569

วันศุกร์ ที่ 5 มิถุนายน พ.ศ. 2569

วันศุกร์ ที่ 5 มิถุนายน พ.ศ. 2569

วันศุกร์ ที่ 5 มิถุนายน พ.ศ. 2569

“โลกแห่งศตวรรษที่ 21 นั้น เทคโนโลยีปัญญาประดิษฐ์ (AI) และ Machine Learning (ML) ได้รับความนิยมเป็นซูเปอร์ฮิตราวกับแก้วสารพัดนึก แต่ยังมีคำถามว่าปลอดภัยไว้วางใจได้ 100% หรือไม่?” ซึ่งทีมวิจัยไทย-ญี่ปุ่น โดยคณะวิศวกรรมศาสตร์ มหาวิทยาลัยมหิดล ร่วมกับ สถาบันวิทยาศาสตร์และเทคโนโลยีขั้นสูงแห่งประเทศญี่ปุ่น หรือ JAIST (Japan Advanced Institute of Science and Technology)

เปิดผลวิจัยสุดเซอร์ไพรส์โดยได้รับการตีพิมพ์ในวารสารนานาชาติเรื่อง “การโจมตีการเรียนรู้ของเครื่องผ่านรูปแบบตัวอย่างปฏิปักษ์ (Attacking Machine Learning With Adversarial Examples)”ชี้ให้เห็นว่า Machine Learning ยังมีช่องโหว่ภัยความเสี่ยงจากการโดนโจมตีที่จะสร้างความเสียหายได้ ตอกย้ำว่าแม้เทคโนโลยีจะเลิศล้ำเพียงใด ยังจำเป็นต้องมีมนุษย์ตรวจสอบเพื่อยืนยันผลลัพธ์ที่เชื่อถือได้

รศ.ดร.จักรกฤษณ์ ศุทธากรณ์ คณบดีคณะวิศวกรรมศาสตร์ มหาวิทยาลัยมหิดล กล่าวว่า ปัจจุบันเทคโนโลยี AI และ Machine Learning (ML) มีบทบาทในวิถีชีวิตของประชาชน การทำงานและหลายธุรกิจอุตสาหกรรม เช่น การแพทย์สุขภาพ ธุรกิจการค้า อี-คอมเมิร์ซ ตลาดทุนการเงิน ยานยนต์ขนส่งโลจิสติกส์ โทรคมนาคม การผลิตในอุตสาหกรรม ความมั่นคงปลอดภัยจึงเป็นเรื่องสำคัญ

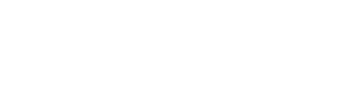

ซึ่งผลงานวิจัย การโจมตีการเรียนรู้ของเครื่องผ่านรูปแบบตัวอย่างปฏิปักษ์ นี้ได้รับการตีพิมพ์ในวารสารนานาชาติ Journal of Imaging นับเป็นงานวิจัยระดับนานาชาติที่ได้รับความสนใจอย่างสูงจากประชาคมโลก เนื่องจากเป็นครั้งแรกที่มีการออกแบบการโจมตี ML Model ในรูปแบบของ QR Code ซึ่งจะเป็นประโยชน์ต่อความมั่นคงปลอดภัยของบริการที่เข้าถึงประชาชนและองค์กรในวงการต่างๆ

“ทีมนักวิจัยไทย-ญี่ปุ่น จำนวน 3 คน จากการผนึกความร่วมมือระหว่างคณะวิศวกรรมศาสตร์ มหาวิทยาลัยมหิดล และสถาบันวิทยาศาสตร์และเทคโนโลยีขั้นสูงแห่งประเทศญี่ปุ่น (JAIST) ประกอบด้วยดร.กรินทร์ สุมังคะโยธิน อาจารย์ภาควิชาวิศวกรรมคอมพิวเตอร์ คณะวิศวกรรมศาสตร์ มหาวิทยาลัยมหิดล ศ.โคตานิ คาซุโนริ และ ผศ.ปริญญา ศิริธนวันต์ จากสถาบัน JAIST” รศ.ดร.จักรกฤษณ์ กล่าว

ดร.กรินทร์ สุมังคะโยธิน อาจารย์ภาควิชาวิศวกรรมคอมพิวเตอร์ คณะวิศวกรรมศาสตร์ มหาวิทยาลัยมหิดล กล่าวถึงที่มาของงานวิจัย ว่า AI ปัญญาประดิษฐ์เป็นการทำให้คอมพิวเตอร์หรือเครื่องจักรฉลาด ส่วน Machine Learning (ML) เป็นหนึ่งในกระบวนการเรียนรู้ของ AI โดยการนำเข้าข้อมูลสู่อัลกอริทึม เพื่อสร้างโครงข่ายการตัดสินใจในการคาดคะเนแนวโน้มหรือทำนายผลลัพธ์ คล้ายคลึงกับการตัดสินใจของมนุษย์ เพื่อลดภาระงานหนักและความผิดพลาดจากความเหนื่อยล้า ตัดสินใจได้รวดเร็วกว่าเมื่อเทียบกับการทำงานของมนุษย์

อย่างไรก็ตาม ความเข้าใจถึงโครงสร้างการตัดสินใจของเน็ตเวิร์กโมเดลของ Machine Learning นั้นยังคงคลุมเครือ และยังคงเป็นสิ่งที่ต้องทำการศึกษาต่อไป ทำให้ในปัจจุบัน Machine Learning สามารถถูกโจมตีผ่านความคลุมเครือดังกล่าวจากผู้ประสงค์ร้าย เพื่อใช้ประโยชน์จากผลลัพธ์ที่ผิดเพี้ยน ด้วยเหตุนี้ทีมนักวิจัยจึงทำการศึกษาวิจัยด้านการโจมตี ML โดยมีวัตถุประสงค์เพื่อศึกษารูปแบบการโจมตีโดยมุ่งเน้นการโจมตีที่สามารถหลบหลีกการสังเกตจากมนุษย์ ซึ่งอาจจะสร้างความเสียหายหรือผลเสียได้อย่างมหาศาล

ไม่ว่าจะเป็นแวดวงการเงิน การรักษาพยาบาล การสื่อสาร คมนาคมขนส่ง ระบบรักษาความปลอดภัยของข้อมูล ระบบการผลิต จนถึงระบบการป้องกันประเทศ โดยทีมวิจัยวิศวะมหิดล-JAIST ใช้เวลาศึกษาวิจัยร่วมกันกว่า 3 ปีแม้จะมีอุปสรรคช่วงวิกฤตโควิด-19 แต่ก็สามารถทำงานผ่านระบบออนไลน์บนแพลตฟอร์มที่มีประสิทธิภาพระดับสูงของญี่ปุ่น ได้ศึกษาวิเคราะห์และออกแบบ การโจมตีการเรียนรู้ของ ML ผ่านรูปแบบตัวอย่างปฏิปักษ์ บนสมมุติฐานโดยที่มีเป้าหมายในการโจมตี ML Model และสามารถหลบเลี่ยงการสังเกตจากมนุษย์

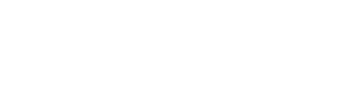

ทำให้ส่งผลกระทบต่อการตัดสินใจผิดพลาดของเครื่องจักร โดยการโจมตีนั้นสามารถมุ่งเป้าไปที่ผลลัพธ์ใดๆ ที่ถูกกำหนดไว้ล่วงหน้าได้ โดยได้กำหนดรูปแบบการโจมตีผ่านข้อมูลที่ถูกซ่อนใน “รูปแบบ QR-Code” สำหรับฟังก์ชั่นการทำงาน ของการโจมตีในรูปแบบ Adversarial Examples เป็นการหลอก AI ให้สับสน โดยการใส่ข้อมูลปนเปื้อนลงไปในข้อมูลเป้าหมาย อาทิ ข้อมูลภาพ,ข้อมูลเสียง, ข้อมูลสัญญาณ หรือข้อมูลประเภทอื่นๆ

โดยผลการโจมตีนั้นมีทั้งแบบการกำหนดผลลัพธ์จากการโจมตีไว้ล่วงหน้า หรือ ทำให้ผลลัพธ์คลาดเคลื่อนจากสิ่งที่ควรจะเป็นได้ สรุปผลการวิจัย สามารถบีบอัดให้ข้อมูลการโจมตีผ่านข้อมูลที่ถูกซ่อนใน QR-Codeที่สามารถสแกนได้ และยังคงความสามารถของการโจมตีแบบมุ่งเป้าหมายผลลัพธ์ได้เป็นอย่างดี ซึ่งนอกจากการใช้ในการทดสอบการโจมตี Machine Learning แล้ว งานวิจัยชิ้นนี้ยังสามารถนำมาใช้พัฒนาระบบป้องกันและตรวจจับการโจมตีจากการวิเคราะห์โดย ML Model ในหลายๆ วัตถุประสงค์อีกด้วย

เช่น ปกป้องความเป็นส่วนตัว ระบบป้องกันทางการทหาร อีกด้วย เป็นการพิสูจน์ให้เห็นว่าการตัดสินใจของ Machine Learning ควรใช้เป็นเพียงเครื่องมือและนวัตกรรมที่ช่วยลดภาระงานของมนุษย์เท่านั้น ท้ายสุดแล้วยังคงต้องได้รับการตรวจสอบจากมนุษย์ผู้เชี่ยวชาญเพื่อยืนยันผลลัพธ์เป็นขั้นตอนสุดท้าย ซึ่งจากความสำเร็จของงานวิจัยชิ้นนี้ แผนในอนาคต ทีมวิจัยไทย-ญี่ปุ่น จะคิดค้นหาวิธีการที่สามารถโจมตีได้มีประสิทธิภาพในระดับสูงยิ่งขึ้นอีก เพื่อก้าวทันเทคโนโลยีใหม่ๆ ที่เปลี่ยนแปลงรวดเร็ว และยังคงไว้ซึ่งความสามารถในการทำงานของรูปแบบข้อมูลดั้งเดิม

(เช่น การโจมตีในรูปแบบ QR-Code ต้อง Scan ได้ เป็นต้น) สำหรับวิธีป้องกันการโจมตีในอนาคต Adversarial Example Attack

มี 2 แนวทาง ได้แก่ 1.ใช้การโจมตี Adversarial Example เพื่อปกป้องข้อมูลจากการถูกตรวจสอบที่ไม่ได้รับอนุญาต 2.ใช้ข้อมูลที่ได้จากการโจมตี Adversarial Example นำกลับมาเพื่อวิเคราะห์ถึงการโจมตี และออกแบบ Machine Learning โมเดลที่ทนทานต่อการโจมตีมากยิ่งขึ้น

“ข้อแนะนำสำหรับในการใช้ Machine Learning อย่างปลอดภัย ให้พึงระวังเสมอว่า ข้อมูลนำเข้าอาจถูกปนเปื้อนการโจมตีมุ่งเป้าในรูปแบบต่างๆ เช่น Adversarial Example หรืออาจพ่วงมากับมัลแวร์ ดังนั้น การใช้ Machine Learning เพื่อการทำงานที่มั่นคงและปลอดภัย มีความจำเป็นต้องมีวาง ระบบการตรวจสอบผลลัพธ์สุดท้ายโดยผู้เชี่ยวชาญ เพื่อความถูกต้องที่เชื่อถือได้อีกครั้ง อย่าปล่อยให้ Machine ทำงาน 100% ในปัจจุบัน AI และ Machine Learning ยังมีข้อจำกัดและจะเป็นตัวช่วยที่ดีได้ก็ต่อเมื่อทั้งคนและเครื่องจักรมีการคิดและทำงานประสานกันอย่างสมดุล ไม่อ้างอิงฝ่ายใดฝ่ายหนึ่งมากจนเกินไป” ดร.กรินทร์ กล่าว

โปรดอ่านก่อนแสดงความคิดเห็น

1.กรุณาใช้ถ้อยคำที่ สุภาพ เหมาะสม ไม่ใช้ ถ้อยคำหยาบคาย ดูหมิ่น ส่อเสียด ให้ร้ายผู้อื่น สร้างความแตกแยกในสังคม งดการใช้ถ้อยคำที่ดูหมิ่นหรือยุยงให้เกลียดชังสถาบันชาติ ศาสนา พระมหากษัตริย์

2.หากพบข้อความที่ไม่เหมาะสม สามารถแจ้งได้ที่อีเมล์ online@naewna.com โดยทีมงานและผู้จัดทำเว็บไซด์ www.naewna.com ขอสงวนสิทธิ์ในการลบความคิดเห็นที่พิจารณาแล้วว่าไม่เหมาะสม โดยไม่ต้องชี้แจงเหตุผลใดๆ ทุกกรณี

3.ขอบเขตความรับผิดชอบของทีมงานและผู้ดำเนินการจัดทำเว็บไซด์ อยู่ที่เนื้อหาข่าวสารที่นำเสนอเท่านั้น หากมีข้อความหรือความคิดเห็นใดที่ขัดต่อข้อ 1 ถือว่าเป็นกระทำนอกเหนือเจตนาของทีมงานและผู้ดำเนินการจัดทำเว็บไซด์ และไม่เป็นเหตุอันต้องรับผิดทางกฎหมายในทุกกรณี